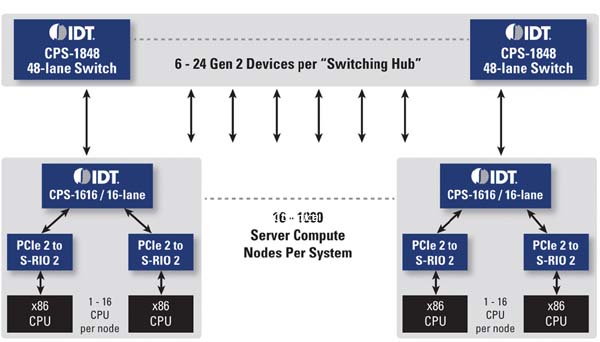

Beispiel einer RapidIO-basierten Hardware-/Serverimplementierung:

Hochdichte, nicht-blockierende Switching-Karten wurden bereits mit RapidIO Gen2-Switches von Integrated Device Technology, Inc. (IDT) entwickelt. Diese Switching-Karten eignen sich für den Einsatz in Rechenzentren und HPC-Umgebungen. Abbildung 1 zeigt eine Switching-Karten-Implementierung, die für Top-of-Rack-Switching genutzt werden kann.

Das IDT Tsi721 Bridge-Gerät, das PCIe Gen2 in RapidIO Gen2 umwandelt, kann zur Anbindung des Serverknotens verwendet werden. Der Tsi721 konvertiert zwischen PCIe und RapidIO und stellt eine Brückenverbindung mit bis zu 20 Gbaud bereit. Mit dem Tsi721 können Entwickler heterogene Systeme realisieren, die die Peer-to-Peer-Netzwerkleistung von RapidIO nutzen und gleichzeitig Mikroprozessorcluster einsetzen, die ausschließlich über PCIe aktiv sind. Der Zielmarkt erfordert die effiziente Übertragung großer Datenmengen ohne Prozessoreingriff. Dies lässt sich durch einen Hochgeschwindigkeits-DMA-Block in Verbindung mit den Messaging-Engines des Tsi721 erreichen. Die Vorteile von RapidIO Typ 9 Messaging, wie Virtualisierungsunterstützung und höherer Durchsatz im Vergleich zu 10 GbE, ermöglichen eine Reduzierung des Verkabelungsaufwands. Dieses Beispielsystem dient als Ausgangspunkt für die weitere Diskussion in diesem Artikel.

In diesem Beispielsystem wird die Kommunikation zwischen zwei Knoten durch zwei separate Konzepte unterstützt: logische E/A und Messaging. Logische E/A-Transaktionen werden sowohl mit direkter Brückenübersetzung als auch mit Block-DMA-Engines unterstützt. DMA und RDMA werden in diesem System unterstützt, da sie für Ethernet-basierte Systeme konzipiert sind. Messaging wird durch Messaging-Engines unterstützt. Ethernet-Messaging wird unter anderem durch TCP unterstützt. RapidIO unterstützt eine einzelne IOV pro Kanal, was weniger ist als bei verfügbaren Ethernet-Lösungen.

Vergleich des Protokolls

Ethernet ermöglicht die Verarbeitung von Datenverkehr in Peer-to-Peer-Netzwerken, sei es zwischen Chips, Boards oder Gehäusen. Es entstand jedoch aus LANs und WANs, da Architekten nach einer effizienten Anwendung in eingebetteten Systemen suchten. Vor diesem Hintergrund setzen LANs und WANs typischerweise einen Prozessor an jedem Knotenpunkt voraus, um den Protokollstapel zu vervollständigen. Dies ist für LANs und WANs eine sinnvolle Annahme, führt aber in Echtzeit-Systemen (einschließlich Servern) zu übermäßiger Latenz und hohem Stromverbrauch.

Die PCI- und PCIe-Standards bieten zwar eine Alternative, wurden aber ursprünglich für monolithische Systeme mit einem einzigen Host-Prozessor und einem Root-Komplex-Konzept entwickelt. Die Skalierung auf mehrere Prozessoren auf Linecards, Backplane-Motherboards und Servern stellt selbst mit nicht-transparenten Bridges eine Herausforderung dar. Für eine geringe Anzahl von Endpunkten oder Rechenknoten lässt sich das Problem lösen, doch die Speicherabbildung wird mit zunehmender Systemgröße schnell komplex.

Da RapidIO von Grund auf für Multi-Prozessor-P2P-Netzwerke konzipiert wurde, bietet es folgende Vorteile: zuverlässige Kommunikation, End-to-End-Paketübermittlung in weniger als einer Mikrosekunde, 100 ns Cut-Through-Switching-Latenz, kein Prozessor-Overhead für die Protokollterminierung, Unterstützung beliebiger Topologien (z. B. direkt, Mesh, Stern, Doppelstern), leistungsstarkes Messaging für die Übertragung großer Datenmengen und eine Push-Architektur mit der Option, dass jeder Prozessor im System über ein eigenes Speichersubsystem verfügt.

RapidIO hat sich zum primären integrierten Verbindungstechnologie entwickelt und bietet mit seiner für Backplane-Anschlüsse spezifizierten seriellen Kommunikation in Carrier-Qualität native Unterstützung für Verbindungen innerhalb einer Platine, zwischen Platinen, drahtgebundene Verbindungen und Verbindungen zwischen Gehäusen innerhalb eines Raums oder zwischen verschiedenen Räumen.

Zur Verbesserung der Ethernet-Performance in eingebetteten Systemen wurden nachfolgende Spezifikationen entwickelt, die über WAN- und LAN-Umgebungen hinausgehen. Diese Erweiterungen für Rechenzentrumsumgebungen werden unter dem Begriff Data Center Bridging (DCB) zusammengefasst. Rechenzentrums- und eingebettete Systeme zeichnen sich durch verlustfreie Übertragung, verbesserte Flusssteuerung und geringe Latenz aus.

Vergleich von QoS und Flusssteuerung:

Ein Grund für den erhöhten Bandbreitenbedarf in Rechenzentren und der Cloud ist die Notwendigkeit, das Speichernetzwerk (typischerweise 8 Gbit/s über Fibre Channel) mit dem Serververbindungsnetzwerk (üblicherweise 1 Gbit/s Ethernet) zu kombinieren. Diese Netzwerke weisen unterschiedliche Einschränkungen hinsichtlich der Dienstgüte auf. Zudem dürfen in Speichernetzwerken keine Pakete verloren gehen. Aktuell bieten RapidIO-basierte Systeme eine zuverlässige Übertragung mit vorhersehbarer Dienstgüte.

Für Anwendungen mit höheren Anforderungen an die Dienstgüte (QoS) bietet RapidIO fortschrittliche Flusssteuerungs- und Datenebenenfunktionen. Das RapidIO-Protokoll definiert mehrere Flusssteuerungsmechanismen auf der physikalischen und logischen Schicht. Durch die Verwaltung der Flusssteuerung auf der Sicherungsschicht werden kurzfristige Überlastungsereignisse effektiv durch die vom Sender und Empfänger gemeinsam gesteuerte Flusssteuerung behandelt. Langfristige Überlastung kann auf der logischen Schicht mithilfe von XOFF- und XON-Nachrichten kontrolliert werden. Diese ermöglichen es dem Empfänger, den Paketfluss zu stoppen, sobald eine Überlastung in einem bestimmten Datenstrom erkannt wird.

Virtuelle Kanäle (VCs) unterstützen neue QoS-Funktionen. Diese Funktionen bieten zuverlässige oder Best-Practice-Übertragungsrichtlinien, verbesserte Flusssteuerung auf der Sicherungsschicht und durchgängiges Verkehrsmanagement. VCs ermöglichen zudem bis zu 16 Millionen einzelne virtuelle Datenflüsse zwischen zwei Endpunkten.

Ethernet hat seine Flusssteuerungsfunktionen durch Fortschritte in der DCB-Technologie (Data Capability Block) verbessert. Diese ermöglicht es einem Ende einer Verbindung, die Übertragung am anderen Ende zu stoppen, um Pufferüberläufe und nachfolgende Paketverluste zu verhindern. Vereinfachtes Paketrouting, ermöglicht durch VLAN-Tagging, sowie die Paketpriorisierung im Rahmen des VLAN-Taggings haben ebenfalls wesentlich zu verbesserter Ethernet-Latenz und Dienstgüte beigetragen.

DCB weist jedoch im Vergleich zu RapidIO zahlreiche Einschränkungen hinsichtlich Flusssteuerung und QoS auf [Vergleich zwischen Ethernet und RapidIO, CompactPCI, AdvancedTCA und MicroTCA, 15. Juli 2010]. Beispielsweise wird die Flusssteuerung in Ethernet primär über 802.3x PAUSE unterstützt. Selbst mit erweiterten Flusssteuerungsmechanismen ist der Aufwand für die Staubenachrichtigung hoch, da sich die Benachrichtigung von der Quelle bis zum Netzwerkrand ausbreitet. In RapidIO hingegen erfolgt die Staubenachrichtigung durch die Übertragung von Steuersymbolen sehr schnell. Offensichtlich sind Ethernet-Mechanismen nicht weit verbreitet, und einige Anbieter bieten proprietäre Unterstützung nur für begrenzte Topologien an. Die Flusssteuerung der Sicherungsschicht von RapidIO ermöglicht es dem Sender, den Empfänger durch kontinuierliche Auslastung zu belasten, was die Effizienz der Ablaufplanung und damit die gesamte Vermittlungseffizienz verbessert.

Leistungsvergleich: Latenz und Durchsatz

Die Latenz von Ethernet-Switches sinkt kontinuierlich, sodass die branchenführenden Ethernet-Switches mittlerweile eine Latenz von etwa 200 ns aufweisen. Die Latenz von RapidIO-Switches liegt jedoch unter 100 ns und sinkt ebenfalls. Dieser Trend wird sich für beide Technologien fortsetzen, da Unternehmen kleinere Siliziumstrukturen und höhere Übertragungsgeschwindigkeiten auf der physikalischen Schicht nutzen. Die End-to-End-Paketterminierung kann bei Ethernet mehr als 10 µs und bei RapidIO weniger als 1 µs betragen.

RapidIO bietet garantierte Zustellung durch Fehlerbehebung auf der Sicherungsschicht. Steuersymbole der Sicherungsschicht minimieren die Latenz der Regelschleife. Steuersymbole können auch in Pakete eingebettet werden, wodurch die Latenz weiter reduziert wird. Verlustfreie DCE erfordert jedoch weiterhin Download-Engines oder Software-Stacks, die tendenziell Latenz verursachen.

RapidIO Gen2-Switches bieten 20 Gbit/s pro Port. Der Tsi721 wandelt PCIe-Daten in RapidIO-Daten und umgekehrt um und stellt so ein Gateway mit einer maximalen Leitungsgeschwindigkeit von 16 Gbit/s für Pakete ab 64 Byte bereit. Dies ist mehr als die üblicherweise verfügbaren 10-GbE-Verbindungen, aber deutlich weniger als die wachsende Anzahl an 40-GbE-Lösungen, die auf den Markt kommen.

Aus Sicht der reinen Bandbreite ist Ethernet RapidIO überlegen. Dieser Unterschied dürfte sich jedoch verringern, sobald die physikalischen Spezifikationen und die Roadmap für zukünftige RapidIO-Versionen verfügbar sind. Die Leistungsfähigkeit und Protokolleffizienz von RapidIO ermöglichen eine robuste Protokollkapselung. Messaging und Datenübertragung bieten native Ethernet-Kapselungsfunktionen.

Sicherheit:

Die empfängerseitigen Sicherheitsfunktionen des Tsi721 für RapidIO sind in Hardware implementiert und können entscheiden, ob eine Reihe von Ziel-IDs akzeptiert wird. Jeder in der RapidIO 2.1-Spezifikation definierte Pakettyp kann akzeptiert oder verworfen werden. Die senderseitige Sicherheit muss in Software implementiert werden.

Die Sicherheit der Switching-Struktur wird durch den Systemhost gewährleistet. Kein Knoten kann mit einem anderen kommunizieren, solange die Routing-Tabellen der Struktur nicht so konfiguriert sind, dass Pakete zwischen den Knoten weitergeleitet werden können. Jeder Switch-Port verfügt zudem über vier Filter, die die ersten 20 Bytes jedes Pakets maskieren, vergleichen und verwerfen können. Diese Funktion kann genutzt werden, um Adressbereiche und Empfänger-IDs für DMA-Lese- und Schreibvorgänge durchzusetzen und zu verhindern, dass andere Knoten als der Systemhost die Switching-Struktur abfragen oder konfigurieren.

Das

RapidIO-System bietet überlegene Leistung und einen günstigeren Preis und ist zweifellos energieeffizienter als Ethernet. Die physikalische Schicht von RapidIO ersetzt die Transportprotokolle von Ethernet und gewährleistet so eine zuverlässige und präzise Nachrichtenübermittlung. Die Protokolllast von Ethernet ist höher, was auch zu einem höheren Energieverbrauch pro übertragenem Datenpunkt beiträgt.

Ethernet-Anbieter verlangen einen Aufpreis für 10-Gbit/s-Ethernet-Ports und noch mehr für 40-Gbit/s-Ports. Die Systemportgebühr für einen 10-Gbit/s-Ethernet-Chip kann mehrere hundert Dollar pro Port betragen, wobei die Kosten für 10G-Switches bei größeren Stückzahlen über 10 Dollar pro Port liegen. Dank weniger komplexer Paketterminierung, kleinerem Paketspeicher und dem Wegfall von Sortieranforderungen sowie weiterer Faktoren belaufen sich die Systemportkosten von RapidIO jedoch auf etwa 55 Dollar, während die Kosten für Switches bei größeren Stückzahlen unter 4 Dollar pro 10G-Port liegen.

Ökosystem:

Aus Sicht des Ökosystems bietet das über 30 Jahre alte Legacy-Ethernet einen deutlichen Vorteil gegenüber den älteren RapidIO-Ökosystemen, die zehn Jahre oder älter sind. Es gibt zahlreiche Anbieter von Siliziumchips, Plattformen, Tools und Software. Das Ethernet-Hardware-Ökosystem umfasst konvergente Netzwerkkarten, Switch- und Router-Plattformen sowie Server- und Speicherplattformen. Das Software-Ökosystem bietet Netzwerkmanagement-Software, Microsoft Windows®, Linux® und eine Vielzahl weiterer Angebote. Hinzu kommen Protokollanalysatoren, Paketanalysatoren, Traffic-Generatoren, Netzwerktester und umfangreiche Erfahrung mit anspruchsvollen Konformitätstests. RapidIO integriert robuste Betriebssysteme, Linux, OFED, Protokollanalyse, Systemdiagnose und verschiedene Serverplattformen. Es verfügt über eine starke Erfolgsbilanz bei der Gen1-Konformität, während die Gen2-Konformität derzeit in Arbeit ist. Einschränkungen bestehen weiterhin hinsichtlich des Windows-Betriebssystems, VMware, Lösungen zur Netzwerkanpassung, NPU-Geräten und Unterstützungsoptionen für Speicherplattformen.

Fazit:

Die Umstellung von 10-GbE auf 40-GbE eröffnet neue Chancen für konkurrierende Verbindungsarchitekturen, die in Unternehmensservern, Rechenzentren, Cloud-Computing und High-Performance-Computing Fuß fassen wollen. RapidIO Gen2 mit seinem Durchsatz von 20 Gbit/s ist dabei ein starker Konkurrent. Systementwickler, die kleinere, weniger ausgereifte RapidIO-Ökosysteme nutzen können, erreichen 20 Gbit/s mit Switches, PCIe-Bridges und allen aktuell verfügbaren Embedded-CPU-Lösungen. Zu den Vorteilen zählen eine fehlertolerante, zuverlässige und hochskalierbare Systemlösung in Carrier-Qualität mit extrem niedrigen Gesamtbetriebskosten. Zudem bietet sie deutlich geringeren Stromverbrauch und niedrigere Latenzzeiten sowie überlegene Flusskontrolle und QoS.

Autor:

Trevor Hiatt, Produktmanager bei IDT.